Un hacker se présentant sous le nom de TeamPCP affirme détenir une importante quantité de données internes appartenant à Mistral AI, la startup française spécialisée dans l’intelligence artificielle générative.

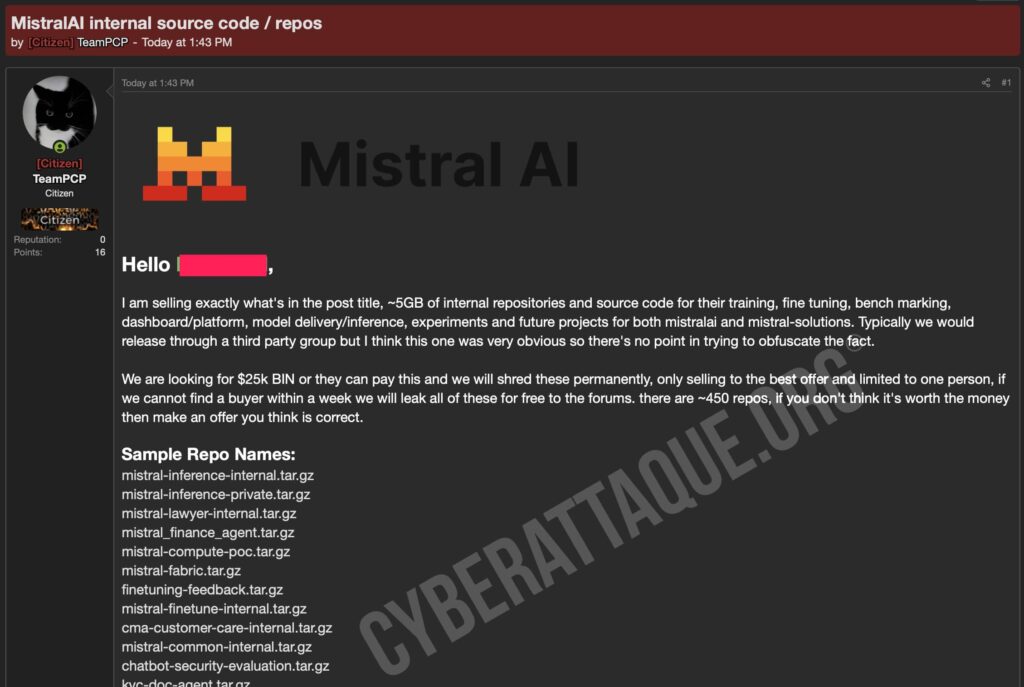

La publication, apparue le 11 mai 2026 sur un forum cybercriminel, évoque environ 5 Go de données internes répartis dans près de 450 dépôts Git privés. Les cybercriminels indiquent proposer une vente exclusive de l’ensemble des archives pour 25 000 dollars et menacent de diffuser publiquement les fichiers dans les prochains jours en l’absence d’acheteur.

Selon les éléments publiés, les données concerneraient principalement des projets internes liés au développement, à l’entraînement et au déploiement des modèles d’intelligence artificielle de Mistral AI.

Des centaines de dépôts GitHub privés revendiqués

D’après les captures et descriptions publiées par les attaquants, les données proviendraient de dépôts Git privés utilisés en interne par les équipes de développement de Mistral AI.

Les cybercriminels évoquent environ 450 repositories privés contenant des projets liés à différents composants de l’infrastructure IA de l’entreprise :

- Entraînement de modèles de langage

- Fine-tuning et optimisation

- Systèmes d’inférence

- Benchmarks et évaluations internes

- Outils de sécurité des modèles

- Tableaux de bord et interfaces internes

- Agents IA spécialisés finance et juridique

- Projets cloud et orchestration d’infrastructure

- Travaux de recherche liés à de futurs produits

Parmi les noms de dépôts mentionnés figurent notamment mistral-inference-private, mistral-finetune-internal, devstral-cloud, mistral-lawyer-internal, chatbot-security-evaluation ou encore dashboard.

Les captures diffusées semblent montrer des interfaces GitHub privées ainsi que des arborescences de projets contenant du code Python, des configurations cloud, des scripts d’automatisation et plusieurs environnements liés à l’entraînement et au déploiement de modèles IA.

À ce stade, il reste impossible de confirmer publiquement l’authenticité complète des fichiers revendiqués ni l’ampleur réelle de l’accès obtenu par les attaquants.

Un incident de sécurité confirmé par Mistral AI

Cette revendication intervient dans un contexte particulier puisque Mistral AI a publié le 12 mai 2026 un avis de sécurité officiel concernant une attaque de la chaîne d’approvisionnement logicielle (supply chain attack) ayant affecté certains packages NPM et PyPi liés à ses SDK développeurs.

Selon l’entreprise, l’incident est lié à une attaque visant l’écosystème TanStack, un ensemble de bibliothèques JavaScript largement utilisées dans le développement web moderne.

Mistral AI explique qu’un ver automatisé associé à cette attaque aurait permis la publication de versions compromises de plusieurs packages officiels utilisés par les développeurs intégrant ses API.

Les versions concernées incluent notamment :

- @mistralai/mistralai versions 2.2.2 à 2.2.4

- @mistralai/mistralai-azure versions 1.7.1 à 1.7.3

- @mistralai/mistralai-gcp versions 1.7.1 à 1.7.3

- mistralai==2.4.6 sur PyPi

D’après l’avis publié par Mistral AI, les packages NPM compromis auraient finalement été peu dangereux, un fichier référencé par le malware n’existant pas réellement.

En revanche, le package Python compromis diffusé sur PyPi est décrit comme beaucoup plus préoccupant. Selon l’entreprise, le code malveillant s’exécutait automatiquement lors de l’import de la bibliothèque sous Linux et lançait un processus en arrière-plan destiné à récupérer des identifiants, secrets et tokens présents sur la machine infectée.

Le malware téléchargeait notamment un fichier hébergé sur l’adresse IP 83.142.209.194 avant de l’exécuter discrètement sur le système compromis.

Mistral AI indique qu’un poste développeur compromis serait impliqué dans cet incident mais précise ne disposer « d’aucune indication montrant une compromission de l’infrastructure de Mistral » à ce stade de l’enquête.

Pourquoi ce type de fuite est particulièrement sensible

Mistral AI, fondée en 2023 par plusieurs anciens chercheurs de Google DeepMind et Meta, est devenue en moins de trois ans l’un des acteurs européens les plus stratégiques du secteur de l’IA générative. L’entreprise développe des grands modèles de langage (LLM) concurrents d’OpenAI, Anthropic ou Google, et collabore déjà avec plusieurs grands groupes ainsi qu’avec des acteurs institutionnels européens.

Contrairement aux cyberattaques classiques impliquant des bases de données clients, une fuite de dépôts Git privés peut avoir des conséquences beaucoup plus stratégiques pour une entreprise technologique.

Dans le secteur de l’intelligence artificielle, les repositories internes peuvent contenir :

- Des pipelines d’entraînement de modèles

- Des techniques d’optimisation propriétaires

- Des configurations cloud sensibles

- Des accès API et secrets techniques

- Des systèmes internes d’orchestration GPU

- Des outils d’évaluation de sécurité des modèles

- Des projets de recherche non publiés

- Des informations sur les futures orientations produits

Une diffusion publique de ce type de données peut permettre à des cybercriminels, concurrents ou acteurs étatiques d’analyser l’architecture interne des services, rechercher des vulnérabilités ou comprendre les méthodes de développement utilisées par l’entreprise.

Dans certains cas, les dépôts privés peuvent également contenir des clés d’accès cloud, des jetons GitHub, des certificats ou des identifiants permettant d’étendre la compromission à d’autres systèmes.

Les environnements de développement sont aujourd’hui devenus des cibles prioritaires pour les groupes cybercriminels spécialisés dans les attaques supply chain.

En infectant directement les postes développeurs ou les bibliothèques utilisées dans les chaînes CI/CD, les attaquants peuvent obtenir des accès extrêmement sensibles sans avoir à cibler directement les infrastructures de production.

Le secteur de l’IA de plus en plus visé

Les entreprises spécialisées dans l’intelligence artificielle représentent désormais des cibles de choix pour les cybercriminels en raison de la valeur stratégique et économique de leurs technologies.

Les modèles d’IA générative, infrastructures GPU, jeux de données, pipelines d’entraînement et outils d’inférence constituent aujourd’hui des actifs critiques pouvant représenter plusieurs années de recherche et des centaines de millions d’euros d’investissement.

Ces derniers mois, plusieurs incidents ont déjà visé des plateformes de développement, des packages open source et des chaînes logicielles utilisées dans l’écosystème IA afin d’infecter directement les développeurs et récupérer des accès internes.

La multiplication des outils open source, des dépendances tierces et des workflows automatisés dans le secteur de l’IA augmente également la surface d’attaque des entreprises technologiques.

À ce stade, Mistral AI n’a pas confirmé publiquement l’authenticité des dépôts revendiqués par TeamPCP ni l’existence d’une compromission interne plus large liée à cette affaire.